Les autorités compétentes pour la mise en œuvre du règlement européen sur l’intelligence artificielle

Une nouvelle réglementation encadre la mise en service, la mise sur le marché et l’utilisation de certains usages de l’intelligence artificielle susceptibles de présenter des risques pour la santé, la sécurité ou les droits fondamentaux.

Le règlement européen (UE) 2024/1689 distingue les exigences auxquelles devront répondre les systèmes d’IA en les catégorisant en fonction de leur impact potentiel, de risque minimal à inacceptable.

Le contrôle de la bonne mise en œuvre de ce règlement sera assuré en France par plusieurs autorités, en accord avec les orientations proposées par le règlement IA lui-même. Ainsi, le contrôle des systèmes d’IA couverts par le règlement postérieurement à cette mise sur le marché ou mise en service sera assuré par les administrations, agences et autorités sectoriellement compétentes ou pertinentes.

Le schéma retenu par le Gouvernement sera mis en œuvre, sous réserve qu’il soit accepté par le Parlement par le biais d'un projet de loi.

Les pratiques interdites

L’Autorité de régulation de la communication audiovisuelle et numérique et la Direction générale de la concurrence, de la consommation et de la répression des fraudes seront garantes du respect de l’interdiction de la mise sur le marché, la mise en service ou l’utilisation de systèmes d’IA qui ont recours à des techniques subliminales, délibérément manipulatrices ou trompeuses (art. 5(1a)) ; et qui exploitent les vulnérabilités liées à l’âge, au handicap ou à la situation sociale ou économique (art. 5(1b)).

Le contrôle du respect de l’interdiction de la mise sur le marché, la mise en service à cette fin spécifique ou l’utilisation de systèmes d’IA destinés à l’évaluation, la classification ou la notation sociale sera assuré par la Commission nationale de l'informatique et des libertés (CNIL) et la DGCCRF (art. 5(1c)).

Le contrôle du respect des autres pratiques interdites à l’article 5 du règlement IA sera également assuré par la CNIL : police prédictive (art. 5(1d)), création ou développement de bases de données de reconnaissance faciale par moissonnage non ciblé (art. 5(1e)), inférence des émotions sur le lieu de travail et dans les établissements d’enseignement (art. 5(1f)), catégorisation biométrique (art. 5(1g)), identification biométrique à distance en temps réel à des fins répressives (art. 5(1h)).

Les systèmes d’IA à haut risque

Systèmes relevant de l’annexe I

Les autorités de surveillance du marché compétentes pour les produits réglementés par les textes listés à l’annexe I du règlement voient leur périmètre élargi afin de contrôler également l’intégration de l’IA dans ces produits lorsque celle-ci conduit à une classification à haut risque au sens du règlement IA.

Consulter la liste et les informations de contact de ces autorités

De même, les autorités notifiantes compétentes pour les produits réglementés par les textes listés à l’annexe I du règlement voient également leur périmètre élargi, en ce qui concerne la notification des organismes en charge de l’évaluation de la conformité (dits « organismes notifiés »).

Consulter la liste et les informations de contact de ces autorités

Systèmes relevant de l’annexe III

Pour les domaines d’usage identifiés à l’annexe III du règlement :

- les Hauts fonctionnaires de défense et de sécurité des ministères de l’Économie, des Finances et de la Souveraineté industrielle et numérique, ainsi que des ministères de l’Aménagement du territoire et Transition écologique seront responsables du contrôle des systèmes d’IA en matière d’infrastructures critiques (ann. III(2)) ;

- l’Autorité de contrôle prudentiel et de résolution (ACPR) sera responsable des systèmes d’IA destinés à être utilisés pour évaluer la solvabilité des personnes physiques, établir leur note de crédit et évaluer les risques et la tarification en matière d’assurance-vie et d’assurance maladie lorsque l’opérateur de ces systèmes d’IA relève de la compétence de l’Autorité (ann. III(5)) ;

- le Conseil d’État, la Cour de Cassation et la Cour des comptes des systèmes d’IA mis en service ou utilisés par les autorités judiciaires à des fins d’administration de la justice (ann. III(8a)) ;

- la CNIL sera chargée du contrôle des systèmes d’IA en matière d’enseignement et de formation professionnelle avec la DGCCRF (ann. III(3)) , en matière de processus démocratiques avec l’Arcom (ann. III(8b)) , et de tous les autres systèmes d’IA relevant de cette annexe III, notamment en matière de biométrie (ann. III(1)) , d’emploi et de gestion de la main d’œuvre (ann. III(4)) , d’usages répressifs (ann. III(6)) ou de migration, asile et contrôle des frontières (ann. III(7)) .

Le règlement n’appelle pas à la désignation d’autorités notifiantes sur le périmètre des usages identifiés à son annexe III.

Les obligations spécifiques de transparence

La CNIL sera chargée du contrôle des obligations applicables aux systèmes de reconnaissance des émotions ou de catégorisation biométrique en vertu de l’article 50(3) du règlement. La DGCCRF et l’Arcom seront quant à elles chargées du contrôle des systèmes d’IA destinés à interagir directement avec des personnes (art. 50(1)) ; qui génèrent des contenus de synthèse ou qui créent des hypertrucages (art. 50(2,3)). L’Arcom est par ailleurs chargée du contrôle des systèmes d’IA qui génèrent ou manipulent des textes publiés dans le but d’informer le public sur des questions d’intérêt public (art. 50(4)).

La création d’un socle de compétences techniques mutualisées

Une mutualisation avancée des compétences et outils techniques en IA et cybersécurité est mise en place par le Pôle d'expertise de la régulation numérique (PEReN) et l'Agence nationale pour la sécurité des systèmes d'information (Anssi) pour appuyer les autorités dans leurs missions de contrôle de la conformité des systèmes d’IA.

Coordination et point de contact unique

La DGCCRF est chargée de la coordination des autorités de surveillance du marché et jouera à ce titre le rôle de point de contact unique en application de l’article 70.2 du règlement.

La DGE continue d’apporter son soutien à la mise en œuvre de ce texte en tant qu’autorité réglementaire en charge du règlement IA et de son rôle au sein du Comité européen de l’IA, où elle représente la France.

Pour toute question

Vous pouvez contacter : reglement-ia@dgccrf.finances.gouv.fr et reglement-ia.dge@finances.gouv.fr

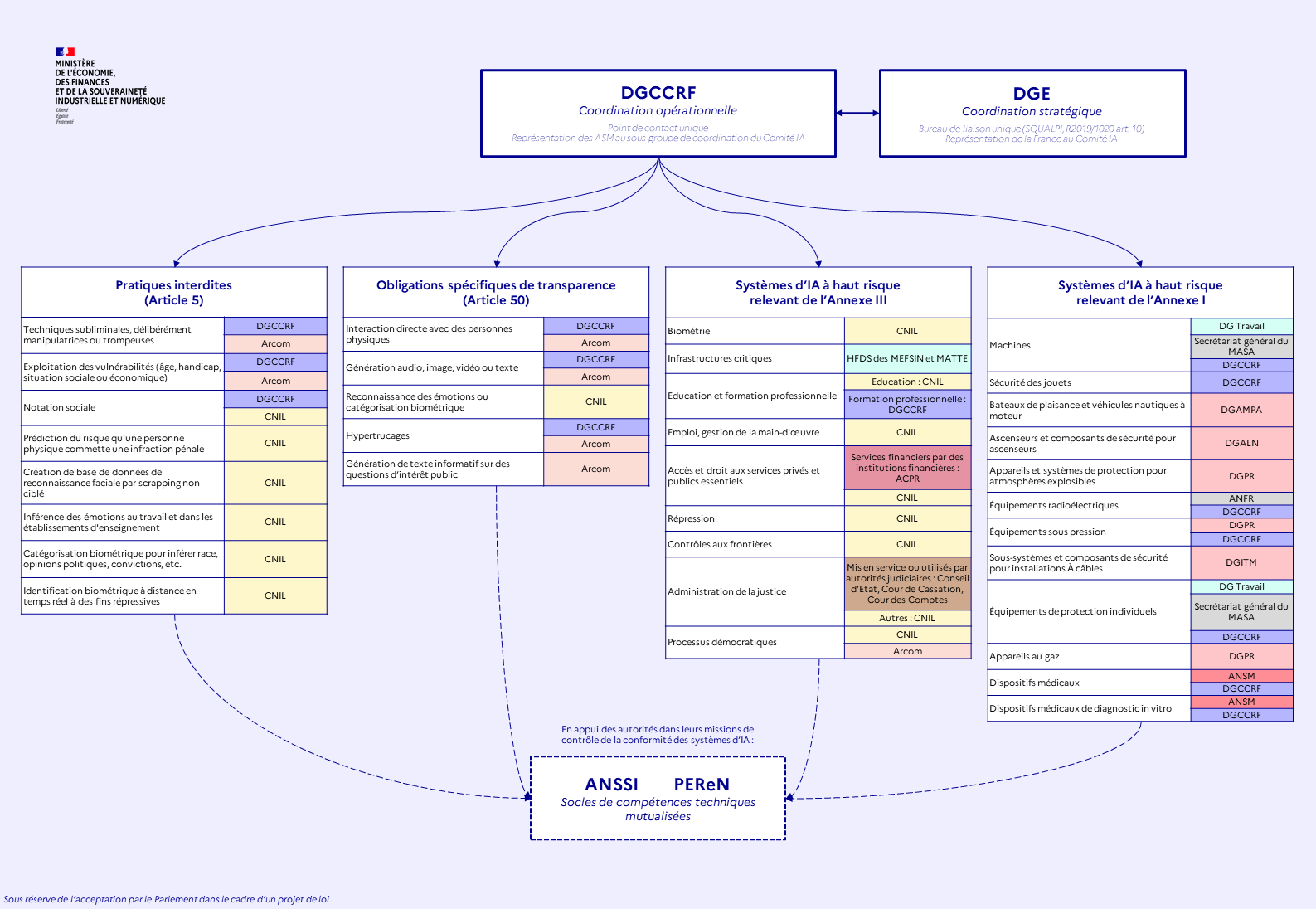

Zoom sur le schéma de gouvernance des autorités de surveillance de marché

DGCCRF : coordination opérationnelle, point de contact unique et représentation des ASM au sous-groupe de coordination du Comité IA

- Pratiques interdites (article 5)

- Techniques subliminales, délibérément manipulatrices ou trompeuses : DGCCRF, Arcom

- Exploitation des vulnérabilités (âge, handicap, situation sociale ou économique) : DGCCRF, Arcom

- Notation sociale : DGCCRF, Cnil

- Prédiction du risque qu'une personne physique commette une infraction pénale : Cnil

- Création de base de données de reconnaissance faciale par scrapping non ciblé : Cnil

- Inférence des émotions au travail et dans les établissements d'enseignement : Cnil

- Catégorisation biométrique pour inférer race, opinions politiques, convictions... : Cnil

- Identification biométrique à distance en temps réel à des fins répressives : Cnil

- Obligations spécifiques de transparence (article 50)

- Interaction directe avec des personnes physiques : DGCCRF, Arcom

- Génération audio, image, vidéo ou texte : DGCCRF, Arcom

- Reconnaissance des émotions ou catégorisation biométrique : Cnil

- Hypertrucages : DGCCRF, Arcom

- Génération de texte informatif sur des questions d'intérêt public : Arcom

- Systèmes d'IA à haut risque relevant de l'annexe III

- Biométrie : Cnil

- Infrastructures critiques : HFDS des MEFSIN et MATTE

- Éducation et formation professionnelle : Cnil (éducation), DGCCRF (formation professionnelle)

- Emploi, gestion de la main d’œuvre : Cnil

- Accès et droit aux services privés et publics essentiels : ACPR (services financiers par des institutions financières), Cnil

- Répression : Cnil

- Contrôles aux frontières : Cnil

- Administration de la justice : Conseil d'État, Cour de cassation, Cour des comptes (mis en service ou utilisés par autorités judiciaires), Cnil (autres)

- Processus démocratiques : Cnil, Arcom

- Systèmes d'IA à haut risque relevant de l'annexe I

- Machines : DG Travail, Secrétariat général du MASA, DGCCRF

- Sécurité des jouets : DGCCRF

- Bateaux de plaisance et véhicules nautiques à moteur : DGAMPA

- Ascenseurs et composants de sécurité pour ascenseurs : DGALN

- Appareils et systèmes de protection pour atmosphères explosibles : DGPR

- Équipements radioélectriques : ANFR, DGCCRF

- Équipements sous pression : DGPR, DGCCRF

- Sous-systèmes et composants de sécurité pour installations à câbles : DGITM

- Équipements de protection individuels : DG Travail, Secrétariat général du MASA, DGCCRF

- Appareils au gaz : DGPR

- Dispositifs médicaux : ANSM, DGCCRF

- Dispositifs médicaux de diagnostic in vitro : ANSM, DGCCRF

En appui des autorités dans leurs missions de contrôle de la conformité des systèmes d'IA : Anssi, PEReN (socles de compétences techniques mutualisées)

DGE : coordination stratégique, bureau de liaison unique (SQUALPI, R2019/120 art. 10), représentation de la France au Comité IA

Sous réserve de l’acceptation par le Parlement dans le cadre d’un projet de loi.

Ceci pourrait vous intéresser

Le G7 s’engage pour un numérique responsable : quatre priorités adoptées sous présidence française

À l’issue de la réunion des ministres du Numérique du G7, qui s'est tenue à Bercy ce vendredi 29 mai, les membres du G7 ont adopté une déclaration commune ambitieuse pour encadrer les opportunités et ...

29 mai 2026

G7 numérique : la France réunit ses partenaires autour de l’intelligence artificielle et des grands enjeux du numérique

La France accueille ce vendredi 29 mai à Bercy la réunion ministérielle du G7 dédiée au numérique. Elle rassemble les ministres du G7 ainsi que des pays partenaires pour approfondir la coopération int...

29 mai 2026